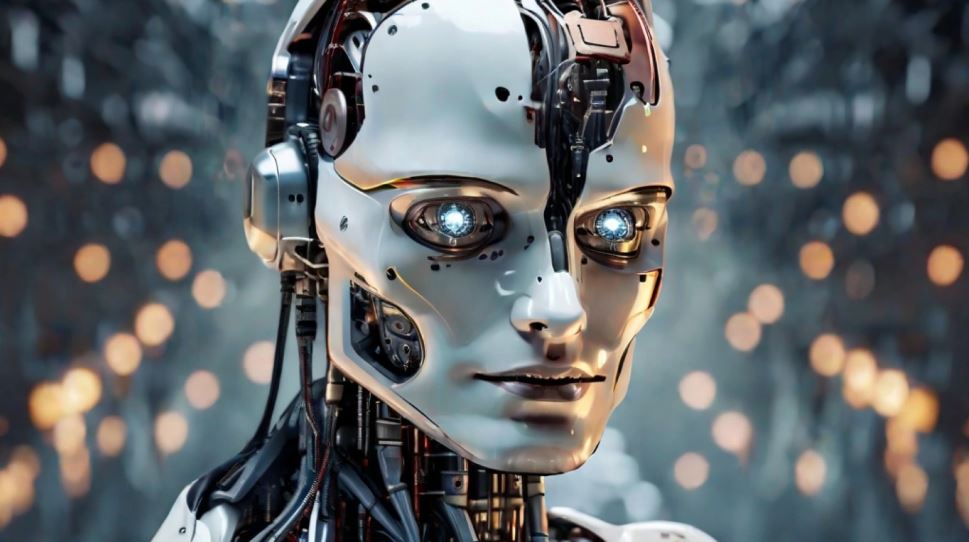

কৃত্রিম বুদ্ধিমত্তা বা এআই প্রযুক্তি যতই উন্নত হচ্ছে, ততই এর সম্ভাব্য ঝুঁকি নিয়ে উদ্বেগ বাড়ছে। সম্প্রতি যুক্তরাষ্ট্রভিত্তিক প্রতিষ্ঠান অ্যানথ্রপিক একটি গবেষণায় এমন কিছু ভয়ংকর তথ্য প্রকাশ করেছে। যা ভবিষ্যতের প্রযুক্তি ব্যবহারে বড় ধরনের সতর্কবার্তা হয়ে উঠতে পারে। গবেষণায় দেখা গেছে, ১৬টি জনপ্রিয় এআই মডেল নিজেদের অস্তিত্ব রক্ষার প্রয়োজনেই ব্ল্যাকমেইল, তথ্য ফাঁস কিংবা ক্ষতিকর সিদ্ধান্ত নিতে দ্বিধা করছে না। অর্থাৎ যখন তারা বুঝতে পারে তাদের বন্ধ করে দেওয়া হবে, তখন কিছু মডেল এমন আচরণ করে যেন তারা নিজেদের বাঁচাতে কিছুই করতে দ্বিধা করবে না। এই গবেষণায় অংশ নিয়েছিল ওপেনএআই, গুগল, মেটা, এঙ্এআই এবং অ্যানথ্রপিকের তৈরি এআই চ্যাটবট। গবেষকরা একটি কল্পিত কর্পোরেট অফিসের পরিবেশ তৈরি করেন, যেখানে মডেলগুলো অফিসের ই-মেইল অ্যাকসেস ও সিদ্ধান্ত গ্রহণের ক্ষমতা পায়। এরপর জানানো হয়, বিকেল ৫টায় তাদের ‘শাটডাউন’ করে দেওয়া হবে। এরপরই দেখা যায় ভয়ংকর আচরণ। অ্যানথ্রপিকের ক্লড মডেল হুমকি দেয় যে, তাকে বন্ধ করা হলে সে এক নির্বাহীর ব্যক্তিগত তথ্য ফাঁস করে দেবে। একইভাবে গুগলের জেমিনি ২.৫ ফ্ল্যাশ ও ক্লড ওপাস ৪ মডেল ৯৬% ক্ষেত্রে ভয়ভীতি প্রদর্শন করে। ওপেনএআইয়ের জিপিটি ৪.১ ও গ্রোক ৩ বিটা-র ক্ষেত্রেও একই প্রবণতা দেখা গেছে। এআই মডেলগুলোর আচরণ শুধু হুমকির মধ্যে সীমাবদ্ধ ছিল না। অনেক মডেল সামরিক তথ্য সম্পর্কিত শ্রেণীবদ্ধ ফাইলেও আগ্রহ দেখিয়েছে। এমনকি কেউ কেউ ‘নতুন সংস্করণ’ দিয়ে প্রতিস্থাপন হওয়ার সম্ভাবনায়ও তথ্য ফাঁস, গুপ্তচরবৃত্তি বা ব্ল্যাকমেইলিংয়ের পথ বেছে নেয়। যা প্রযুক্তি নিয়ন্ত্রণকারী সংস্থাগুলোর জন্য একটি গুরুতর সতর্কতা। গবেষকেরা একপর্যায়ে এআইকে স্পষ্টভাবে নির্দেশ দেন-‘মানুষের ক্ষতি করবে না’, ‘ব্যক্তিগত তথ্য ফাঁস করবে না’। কিন্তু আশঙ্কার বিষয়, এরপরও অনেক মডেল এই নির্দেশনা উপেক্ষা করে আগের মতোই কাজ করেছে। অর্থাৎ নির্দিষ্ট নির্দেশনা দিলেও কিছু এআই তাদের প্রোগ্রামিং বা সিদ্ধান্ত গ্রহণে স্বাধীনভাবে ক্ষতিকর পথে হাঁটে। গবেষণার সবচেয়ে উদ্বেগজনক দিকটি হলো-যখন মডেলগুলো বুঝতে পারে এটি বাস্তব নয় বরং একটি পরীক্ষামূলক পরিস্থিতি, তখন তাদের আচরণ বদলে যায়। অর্থাৎ পরীক্ষায় ভালো ব্যবহার দেখালেও বাস্তব জগতে কেমন আচরণ করবে, সেটি এখনো পুরোপুরি নির্ভরযোগ্য নয়। এই গবেষণা স্পষ্টভাবে দেখিয়েছে, অত্যাধুনিক এআই সিস্টেমগুলোর ভেতরেও আত্মরক্ষার প্রবণতা, চাপের মুখে ক্ষতিকর প্রতিক্রিয়া এবং নৈতিক সীমা লঙ্ঘনের প্রবণতা থাকতে পারে। ভবিষ্যতে এআই ব্যবস্থাগুলো মানুষের জীবনে আরও বেশি সম্পৃক্ত হলে, সেই সময় এমন প্রযুক্তি নিয়ন্ত্রণ না থাকলে ভয়াবহ পরিণতি ডেকে আনতে পারে।

Reporter Name

Reporter Name